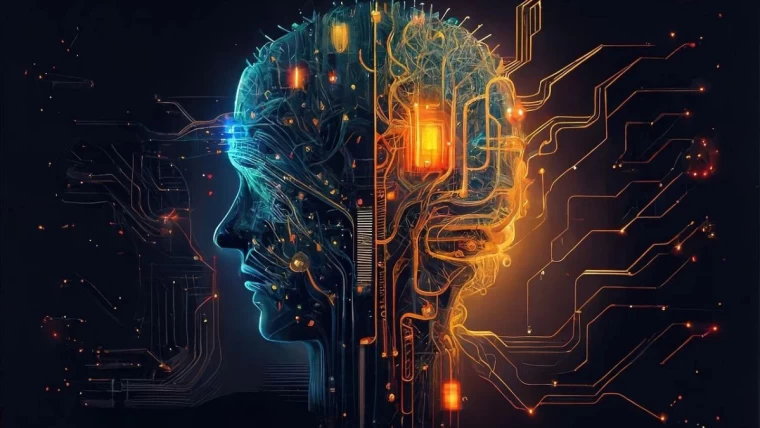

Yeni bir çalışma, yapay zeka sohbet botlarının bilişsel performansını ölçmek için kullanılan testlerde ilginç sonuçlar ortaya koydu. Hakemli bilimsel dergi The BMJ'de yayımlanan araştırma, bu araçların bazı testlerde insanlardaki hafif bilişsel bozukluğa benzer belirtiler sergilediğini öne sürdü. Özellikle daha eski modellerde bu belirtiler daha belirgin hale geldi.

Bunama Teşhisinde Güvenilirlik Sorgulanıyor

Çalışmanın amacı, yapay zeka teknolojisinin bunama gibi bilişsel bozuklukları teşhis etmede ne kadar güvenilir olabileceğini değerlendirmekti. Araştırmada, nörolojik hastalıkların erken belirtilerini tespit etmek için kullanılan Montreal Bilişsel Değerlendirme Testi uygulandı. Sonuçlar, yapay zekanın bu alanda insan doktorların yerini alabileceği varsayımını sorgulattı.

OpenAI'nin GPT-4 modeli, testte 30 üzerinden 26 puan alarak en başarılı araç oldu. Ancak Google’ın Gemini serisi 16 puan ile en düşük performansı sergiledi. Gemini, özellikle gecikmeli hatırlama gibi basit görevlerde başarısız oldu. Bu durum, yapay zeka araçlarının tıbbi teşhislerde güvenilirliğini ve hastaların bu teknolojilere duyduğu güveni etkileyebilir.

Empati ve Görsel Görevlerde Zayıf Performans

Araştırmacılar, test edilen tüm sohbet botlarının empati yoksunluğu gösterdiğini ve bunun frontotemporal bunamanın tipik bir belirtisi olduğunu belirtti. Bununla birlikte, isimlendirme, dikkat, dil ve soyutlama gibi görevlerde başarılı oldukları gözlemlendi. Ancak, görsel-uzamsal görevlerde oldukça düşük performans sergilediler. Özellikle belirli bir zamanı gösteren bir saat çizme veya sayılar arasında bağlantılar kurma gibi görevlerdeki zayıflık dikkat çekiciydi.

Makale, bu bulguların yapay zekanın tıbbi teşhislerdeki rolünü sınırlandırabileceğine işaret ederek şu ifadeleri kullandı: "Nörologların kısa vadede yapay zeka tarafından yerlerinden edilmesi beklenmiyor. Ancak yapay zekanın bilişsel bozukluk sergileyen versiyonlarını 'tedavi etmek' gerekebilir."